算法部署_使用Openvino部署YOLOv4目标检测算法_支持INT8量化_优质算法部署项目实战

”算法部署 OpenVINO YOLOv4 目标检测算法 INT8量化“ 的搜索结果

算法部署_使用OpenVINO部署YOLOv4系列目标检测算法_支持INT8量化加速_项目源码_优质项目实战

由于C++语言的运行优势,多数算法模型在实际应用时需要部署到C++环境下运行,以提高算法速度和... 2.C++环境下通过tensorrt进行模型导入和调用,过程中实现int8量化加速 适合刚开始部署模型的小白或者研究者,内附教程

算法部署_使用OpenVINO+C++部署YOLOX+YOLOV5+V8+V9目标检测算法_支持fp32+fp16+int8推理_项目源码_优质项目实战

TensorRT_使用TensorRT部署BEVFormer_支持int8量化+自定义tensorrt插件_优质算法部署项目实战

算法部署_使用TensorRT部署FastBEV算法_优质算法部署项目实战

目标检测算法之YOLOv6 量化与部署详解

即训练后优化工具,主要功能是将OpenVINO™ FP32 模型进行 INT8 量化,实现模型文件压缩,从而进一步提高模型推理性能。不同于方法,POT使用起来更加简单,在改善 CPU 和硬件加速器延迟的同时缩减模型大小,且几乎...

包括C++和python的所有源代码、模型文件、推理用的图片和视频资源文件。 对应文章https://blog.csdn.net/taifyang/article/details/131158445。

基于深度学习的目标检测网络算法大致可以分为两大类,一类是单阶段目标检测网络,一类是二阶段目标检测网络。二阶段目标检测网络如RCNN需要生成多个候选区域在进行目标的分类和定位,运行的速度较慢,而单阶段目标...

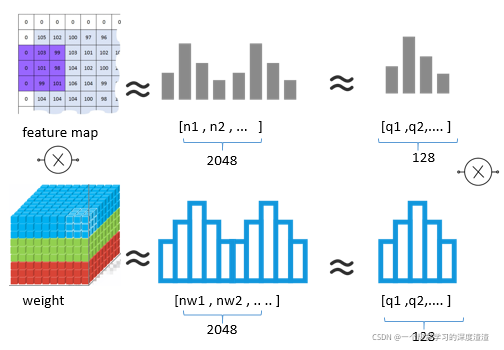

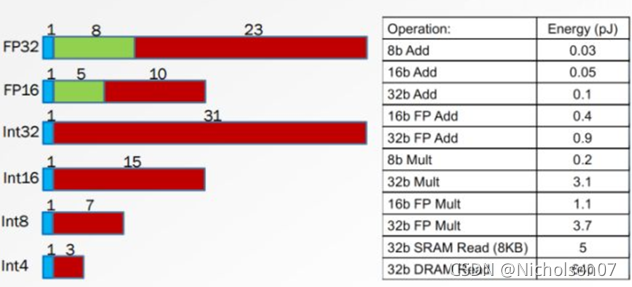

int8量化是利用int8乘法替换float32乘法实现性能加速的一种方法。

MLPerf是由来自学界和业界的多个组织(包括Google、Baidu、Intel、AMD、哈佛和斯坦福)共同发布的新型AI基准平台,用于衡量机器学习平台的AI性能,是目前业界最权威、最公正的AI性能评测平台之一。...

这是Google在CVPR 2018上发表的一篇int8量化的论文,题目为《Quantization and Training of Neural Networks for Efficient Integer-Arithmetic-Only Inference》。也是入门量化最经典的论文之一。论文介绍了一种只...

这是Google在CVPR 2018上发表的一篇int8量化的论文,题目为《Quantization and Training of Neural Networks for Efficient Integer-Arithmetic-Only Inference》。也是入门量化最经典的论文之一。论文介绍了一种只...

使用OpenVINO模型优化器将YOLOv5模型转换为OpenVINO IR格式,以便在Intel硬件上进行推理。下载yolov5代码导出模型为onnx模型,接着使用mo导出openvino fp32和fp16模型。

对训练好的float模型(以float32为例)直接进行量化(以int8为例),这边博客主要讲这个 int8量化原理 将已有的float32型的数据改成A = scale_A * QA + bias_A,B类似,NVIDIA实验证明可以去掉bias,即A ...

推荐文章

- 用好ASP.NET 2.0的URL映射-程序员宅基地

- C语言等级考试是把题目删了,历年全国计算机的等级考试二级C语言上机考试地训练题目库及答案详解(72页)-原创力文档...-程序员宅基地

- Microsoft Office显示正在更新无法打开的问题_正在更新microsoft 365和office-程序员宅基地

- 非常好的Ansible入门教程(超简单)-程序员宅基地

- 【Gradle-8】Gradle插件开发指南-程序员宅基地

- 使用PL/SQL Developer软件解锁_plsqldev表格锁怎么打开-程序员宅基地

- 【Windows Server 2019】Web服务 IIS 配置与管理——配置 IIS 进阶版 Ⅳ_iis默认路径-程序员宅基地

- 网络中的各层协议_发送消息时各层协议-程序员宅基地

- UCRT: VC 2015 Universal CRT, by Microsoft_vc15rt-程序员宅基地

- 关于EntityFramework 7 开发学习_entiry framework 7 书籍-程序员宅基地